《互聯網信息服務深度合成管理規定》發布,明年1月實施,為AI生成內容劃定安全邊界

國家互聯網信息辦公室、工業和信息化部、公安部近日聯合發布了《互聯網信息服務深度合成管理規定》(以下簡稱《規定》)。這部旨在規范深度合成技術應用、維護網絡空間清朗的重要法規,將于2023年1月10日起正式施行。它的出臺,標志著我國在快速發展的生成式人工智能領域,邁出了關鍵性的立法監管步伐,為“互聯網信息服務”的健康發展提供了明確指引和堅實保障。

《規定》聚焦于利用深度學習、虛擬現實等生成或顯著改變信息內容的合成技術,即公眾熟知的“深度合成”或“深度偽造”(Deepfake)技術。這類技術能夠生成逼真的圖像、音頻、視頻、文本等內容,在娛樂、教育、創意等領域展現出巨大潛力,但同時也帶來了虛假信息傳播、人格權侵害、詐騙等一系列嚴峻的社會風險和安全隱患。

《規定》的核心在于構建一套貫穿深度合成服務全流程的治理框架,明確了主體責任、技術標準與用戶權益。其主要內容包括:

- 明確責任主體:強調深度合成服務提供者(即技術支持者)和深度合成服務使用者均應承擔相應責任。提供者需落實信息安全主體責任,建立健全管理制度;使用者則需遵守法律法規,尊重社會公德和倫理,不得利用深度合成服務從事違法和不良信息的制作、復制、發布和傳播。

- 強化標識管理:這是《規定》的一大亮點。要求深度合成服務提供者對生成或編輯的、可能引發公眾混淆或誤解的信息內容,進行顯著標識。例如,AI生成的新聞播報視頻、換臉的公眾人物影像等,都必須明確標注為“合成”。這有助于提升信息透明度,保障公眾的知情權和選擇權。

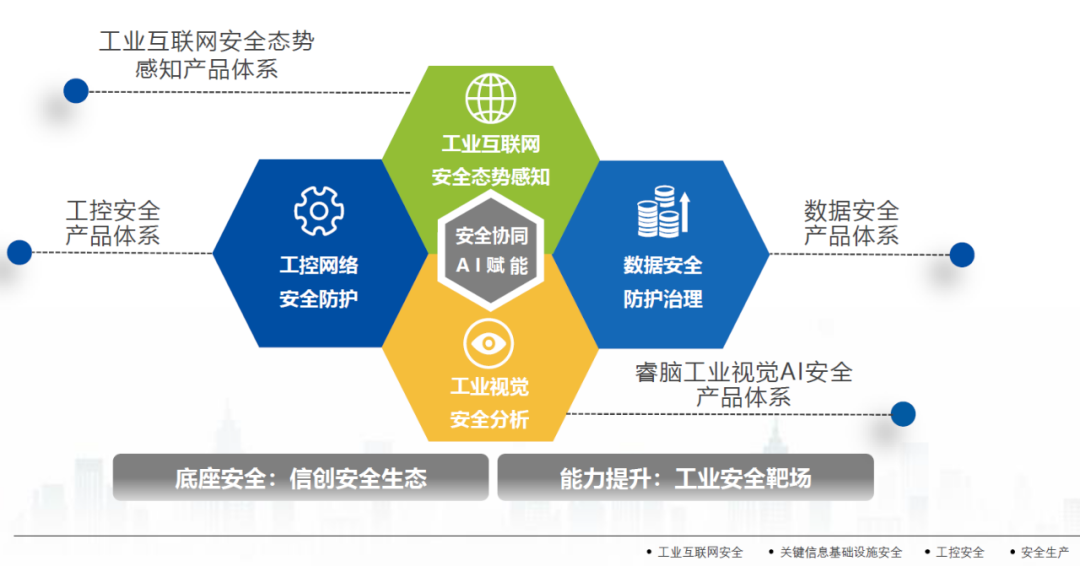

- 健全技術保障:要求提供者采取技術措施,確保深度合成服務安全可控。這包括對生成內容進行審核、建立辟謠機制、防范信息內容被用于違法犯罪等。提供者還需加強訓練數據管理,確保數據來源合法,并采取措施防止生成違法和不良信息。

- 注重用戶權益保護:規定提供者應依法保護用戶個人信息,不得非法處理用戶個人信息。對于具有生成或編輯人臉、人聲等生物識別信息功能的模型、模板等工具,應要求使用者進行真實身份信息認證。這有效回應了社會對“AI換臉”可能侵犯肖像權、隱私權的普遍擔憂。

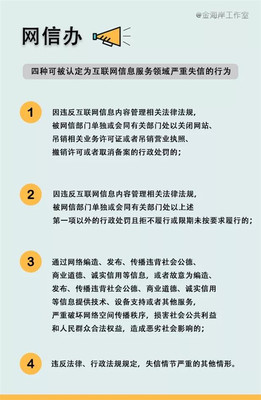

- 劃清安全底線:明確禁止利用深度合成服務從事危害國家安全、損害國家利益、擾亂經濟社會秩序、侵犯他人合法權益等法律法規禁止的活動。這為技術應用劃定了清晰的“紅線”。

《規定》的發布與實施,具有重要而深遠的意義:

- 回應技術挑戰,填補監管空白:面對深度合成技術帶來的新問題、新挑戰,《規定》及時出臺,填補了我國在該領域的專項法規空白,使監管有法可依,為產業健康發展提供了穩定預期。

- 促進行業自律與規范發展:通過設定明確規則,引導和督促相關企業將安全、倫理和責任內置于技術研發與應用的全過程,推動行業從“野蠻生長”走向“有序創新”。

- 維護網絡空間秩序與公民權益:通過標識義務、內容審核、數據管理等要求,有效遏制深度偽造技術濫用于造謠、誹謗、詐騙等行為,保護公民個人信息、肖像權、名譽權等合法權益,維護清朗網絡空間。

- 提升公眾信息素養與辨別能力:強制性的內容標識,有助于公眾在面對海量信息時,提高對合成內容的警惕性和辨別力,培養更加理性的信息消費習慣。

隨著2023年1月10日施行日期的臨近,相關互聯網信息服務提供者需盡快對照《規定》要求,完成技術升級、制度完善與合規調整。監管部門也將依法開展監督執法,確保《規定》落到實處。可以預見,《互聯網信息服務深度合成管理規定》將與《網絡安全法》、《數據安全法》、《個人信息保護法》等共同構成我國網絡空間治理的法律基石,為人工智能時代的“互聯網信息服務”保駕護航,推動技術向善,造福社會。這是一個平衡技術創新與安全治理的積極嘗試,對中國乃至全球的數字治理都具有重要的參考價值。

如若轉載,請注明出處:http://www.jidmar.com/product/30.html

更新時間:2026-02-20 03:17:09